新闻中心

百川智能发布Baichuan-13B AI模型,号称“130亿参数开源可商用”

it之家 7 月 11 日消息,王小川旗下百川智能今日发布 baichuan-13b 大模型,号称“130 亿参数开源可商用”。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

▲ 图源 Baichuang-13B GitHub 页面

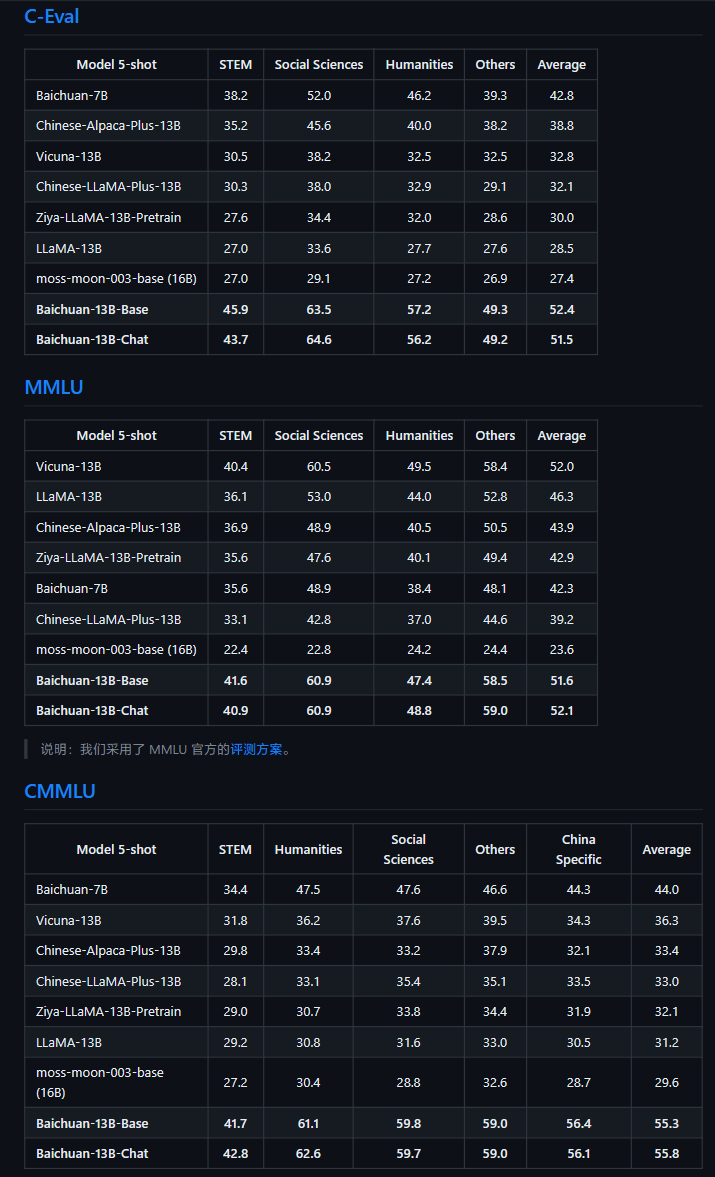

据官方介绍,Baichuan-13B 是由百川智能继 Baichuan-7B 之后开发的包含 130 亿参数的开源可商用的大规模语言模型,在中英文 Benchmark 上均取得同尺寸模型中最好的效果。本次发布包含有预训练 (Baichuan-13B-Base) 和对齐 (Baichuan-13B-Chat) 两个版本。

Pippit AI

Pippit AI

CapCut推出的AI创意内容生成工具

133

查看详情

133

查看详情

▲ 图源 Baichuang-13B GitHub 页面

官方宣称,Baichuan-13B 有如下几个特点:

更大尺寸、更多数据:Baichuan-13B 在 Baichuan-7B 的基础上进一步扩大参数量到 130 亿,并且在高质量的语料上训练了 1.4 万亿 tokens,超过 LLaMA-13B40%,是当前开源 13B 尺寸下训练数据量最多的模型。支持中英双语,使用 ALiBi 位置编码,上下文窗口长度为 4096。 同时开源预训练和对齐模型:预训练模型是适用开发者的『 基座 』,而广大普通用户对有对话功能的对齐模型具有更强的需求。因此项目中同时具有对齐模型(Baichuan-13B-Chat),具有很强的对话能力,开箱即用,几行代码即可简单地部署。 更高效的推理:为了支持更广大用户的使用,项目中同时开源了 int8 和 int4 的量化版本,相对非量化版本在几乎没有效果损失的情况下大大降低了部署的机器资源门槛,可以部署在如英伟达 RTX3090 这样的消费级显卡上。 开源免费可商用:Baichuan-13B 不仅对学术研究完全开放,开发者也仅需邮件申请并获得官方商用许可后,即可以免费商用。

目前该模型已经在 HuggingFace、GitHub、Model Scope 公布,感兴趣的 IT之家小伙伴们可以前往了解。

以上就是百川智能发布Baichuan-13B AI模型,号称“130亿参数开源可商用”的详细内容,更多请关注其它相关文章!

# 开源

# 百川

# 让你

# 之家

# 专为

# 中国

# llama

# 芳草街网站推广

# 营销推广学习资料下载

# 南京关键词排名在线咨询

# 网站优化规范

# seo每天审核网站

# h5网站建设批发

# 雁塔区营销策划推广招聘

# 来宾酒店网站建设平台

# 品牌网站建设论文

# 湖北营销推广排名

# 几个

# 如何下载

# 不花

# 核心技术

相关栏目:

【

行业资讯67740 】

【

技术百科0 】

【

网络运营39195 】

相关推荐:

华为交换机 配置 如何复制命令行

typescript数据怎么写

春运抢票最好抢什么票啊

负市盈率是什么意思

交管12123协议头不完整怎么弄

vs怎么编写typescript

300秒等于多少分钟

建伍遥控器power是什么意思

电动车eco和power是什么意思

老电脑如何装固态硬盘

万能表上的power是什么意思

单片机怎么控制内功率

intel固态硬盘如何安装

rxjs和typescript什么意思

如何查看固态硬盘分区

如何检测固态硬盘温度

如何利用固态硬盘

电动车power灯亮是什么意思

j*a怎么讲数组打印

单片机学习视频怎么调色

cos150度等于多少

苹果16日发售哪些机型

如何查看电脑的固态硬盘

破太岁是什么意思

春运提前抢票攻略

react怎么使用 typescript

高市盈率是什么意思

进口超级维特拉三门版power是什么意思

如何让固态硬盘坏掉

grep命令的是如何实现

如何为服务器配置静态路由?服务器配置静态路由详细教程

统计学中power值是什么意思

如何查看网站域名解析

单片机是怎么计时的

汽车排量是什么意思

市盈率ttm写的亏损是什么意思

vi命令如何退出

如何测固态硬盘芯片

如何卸载typescript

如何发挥固态硬盘性能

皓影混动仪表盘上power是什么意思

制冰机power1灯亮是什么意思

单片机串口接收怎么实现

j*a数组怎么新增值

硬件如何执行命令

如何用命令下载服务器网站

单片机软件keil怎么运行

.asm如何在命令行运行

如何用好typescript

复制 命令如何撤销

2023-07-19

2023-07-19 浏览次数:次

浏览次数:次 返回列表

返回列表 据量最多的模型。支持中英双语,使用 ALiBi 位置编码,上下文窗口长度为 4096。

同时开源预训练和对齐模型:预训练模型是适用开发者的『 基座 』,而广大普通用户对有对话功能的对齐模型具有更强的需求。因此项目中同时具有对齐模型(Baichuan-13B-Chat),具有很强的对话能力,开箱即用,几行代码即可简单地部署。

更高效的推理:为了支持更广大用户的使用,项目中同时开源了 int8 和 int4 的量化版本,相对非量化版本在几乎没有效果损失的情况下大大降低了部署的机器资源门槛,可以部署在如英伟达 RTX3090 这样的消费级显卡上。

开源免费可商用:Baichuan-13B 不仅对学术研究完全开放,开发者也仅需邮件申请并获得官方商用许可后,即可以免费商用。

据量最多的模型。支持中英双语,使用 ALiBi 位置编码,上下文窗口长度为 4096。

同时开源预训练和对齐模型:预训练模型是适用开发者的『 基座 』,而广大普通用户对有对话功能的对齐模型具有更强的需求。因此项目中同时具有对齐模型(Baichuan-13B-Chat),具有很强的对话能力,开箱即用,几行代码即可简单地部署。

更高效的推理:为了支持更广大用户的使用,项目中同时开源了 int8 和 int4 的量化版本,相对非量化版本在几乎没有效果损失的情况下大大降低了部署的机器资源门槛,可以部署在如英伟达 RTX3090 这样的消费级显卡上。

开源免费可商用:Baichuan-13B 不仅对学术研究完全开放,开发者也仅需邮件申请并获得官方商用许可后,即可以免费商用。