新闻中心

小而强大的模型盛火兴起:TinyLlama和LiteLlama成为热门选择

当前,研究者开始关注小巧且高性能的小模型,尽管大家都在研究参数规模达到百亿甚至千亿级别的大模型。

小模型在边缘设备上有广泛应用,如智能手机、物联网设备和嵌入式系统。这些设备通常计算能力和存储空间有限,无法有效运行大型语言模型。因此,研究小型模型变得尤为重要。

接下来我们要介绍的这两项研究,可能满足你对小模型的需求。

TinyLlama-1.1B

新加坡科技设计大学(SUTD)的研究者最近发布了TinyLlama,这是一个参数量为11亿的语言模型,经过在大约3万亿个token上的预训练。

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

- 论文地址:https://arxiv.org/pdf/2401.02385.pdf

- 项目地址:https://github.com/jzhang38/TinyLlama/blob/main/README_zh-CN.md

TinyLlama是基于Llama 2架构和分词器的,这使得它可以轻松地与许多使用Llama的开源项目集成。此外,TinyLlama只有11亿个参数,体积小巧,非常适合那些需要限制计算和内存占用的应用程序。

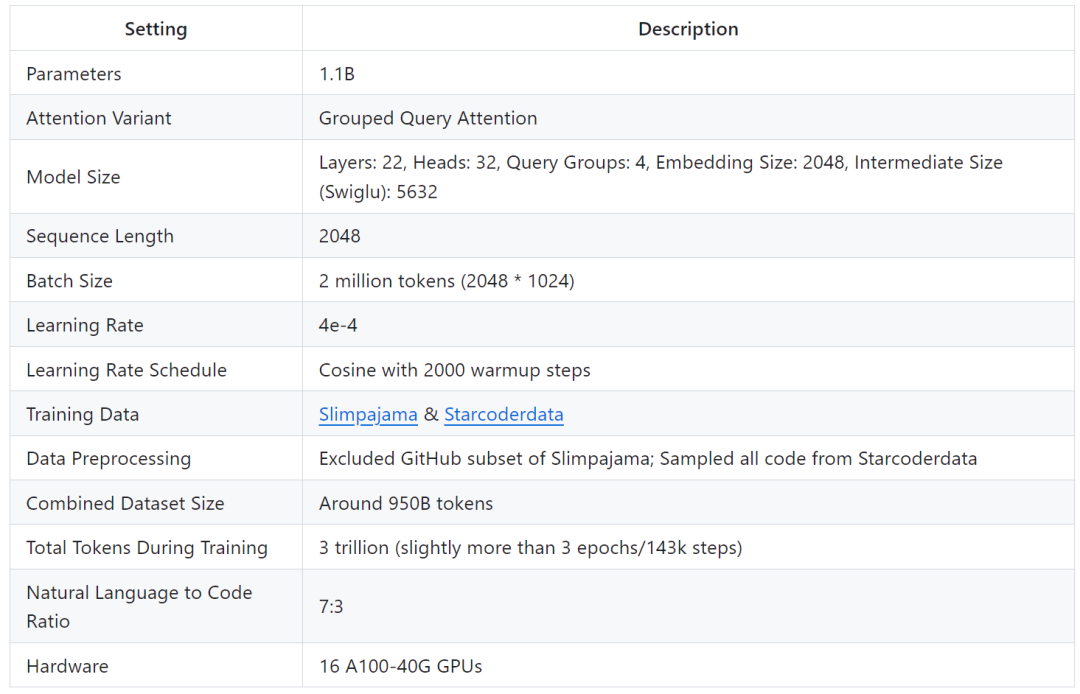

该研究表示仅需 16 块 A100-40G 的 GPU,便可在 90 天内完成 TinyLlama 的训练。

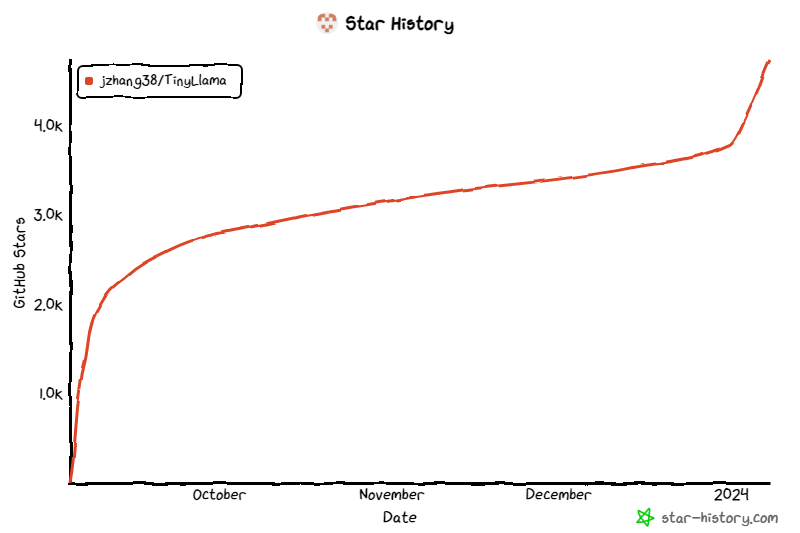

该项目从上线开始,持续受到关注,目前星标量达到 4.7K。

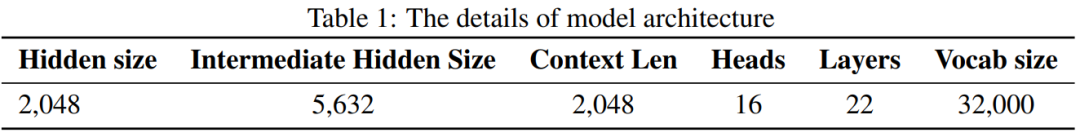

TinyLlama 模型架构详细信息如下所示:

训练细节如下:

研究者表示,这项研究旨在挖掘使用较大数据集训练较小模型的潜力。他们重点探究在用远大于扩展定律(scaling law)建议的 token 数量进行训练时,较小模型的行为表现。

具体来说,该研究使用大约 3 万亿个 token 训练具有 1.1B 个参数的 Transformer (仅解码器)模型。据了解,这是第一次尝试使用如此大量的数据来训练具有 1B 参数的模型。

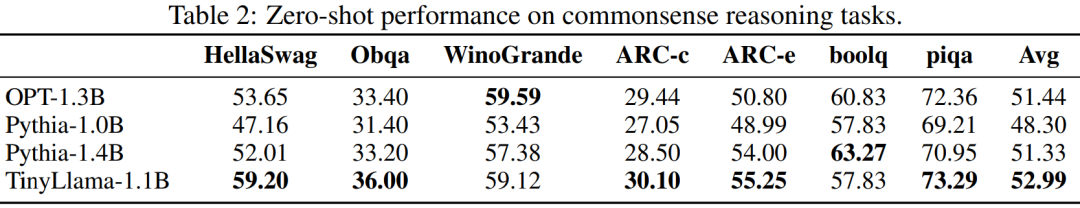

尽管规模相对较小,但 TinyLlama 在一系列下游任务中表现相当出色,它的性能显著优于同等大小的现有开源语言模型。具体来说,TinyLlama 在各种下游任务中都超越了 OPT-1.3B 和 Pythia1.4B 。

此外,TinyLlama 还用到了各种优化方法,如 flash attention 2、FSDP( Fully Sharded Data Parallel )、 xFormers 等。

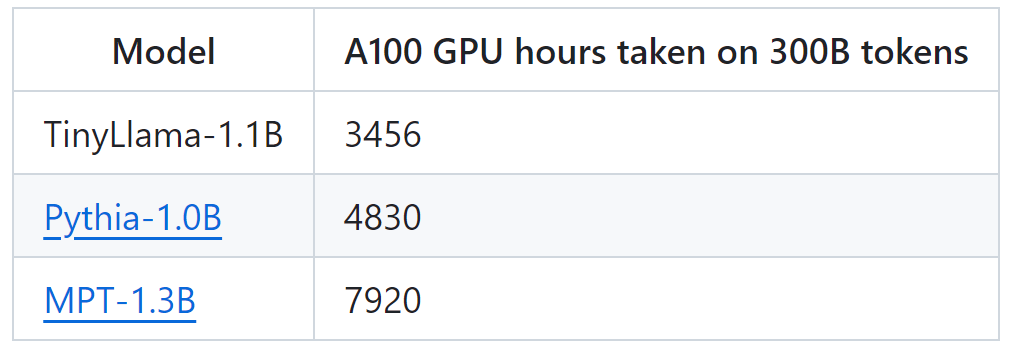

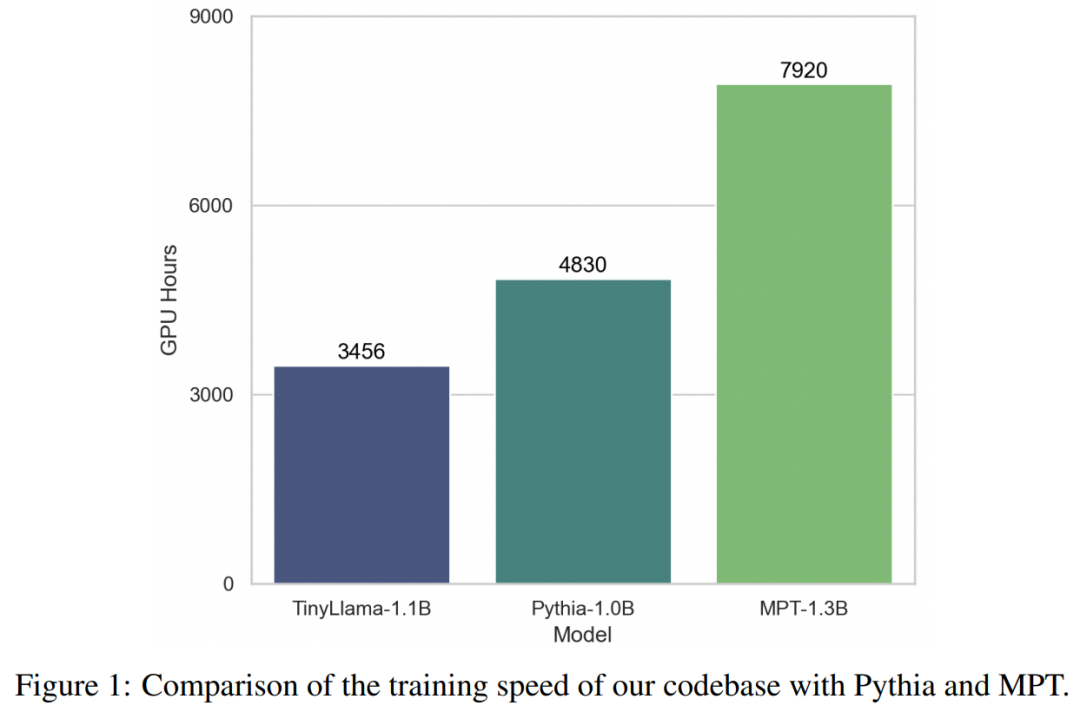

在这些技术的加持下,TinyLlama 训练吞吐量达到了每 A100-40G GPU 每秒 24000 个 token。例如,TinyLlama-1.1B 模型对于 300B token 仅需要 3,456 A100 GPU 小时,而 Pythia 为 4,830 小时,MPT 为 7,920 小时。这显示了该研究优化的有效性以及在大规模模型训练中节省大量时间和资源的潜力。

TinyLlama 实现了 24k tokens / 秒 / A100 的训练速度,这个速度好比用户可以在 8 个 A100 上用 32 小时训练一个具有 11 亿参数、220 亿 token 的 chinchilla-optimial 的模型。同时,这些优化也大大减少了显存占用,用户可以把 11 亿参数的模型塞入 40GB 的 GPU 里面还能同时维持 16k tokens 的 per-gpu batch size。只需要把 batch size 改小一点, 你就可以在 RTX 3090/4090 上面训练 T inyLlama。

inyLlama。

VALL-E

VALL-E

VALL-E是一种用于文本到语音生成 (TTS) 的语言建模方法

134

查看详情

134

查看详情

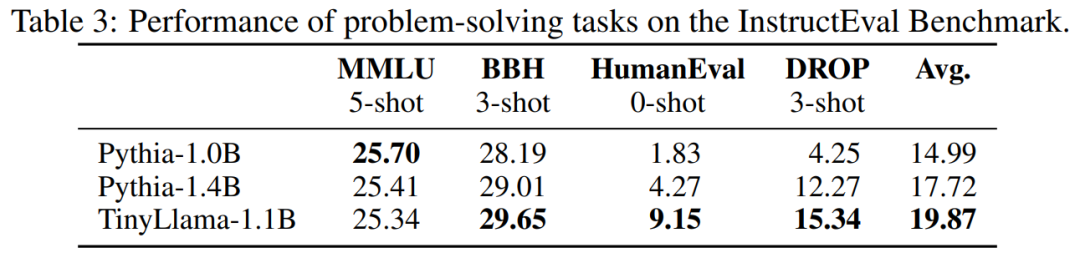

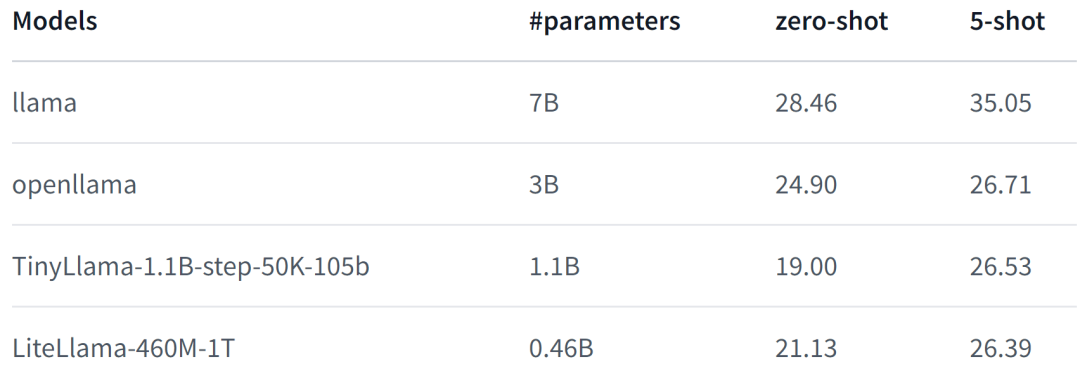

实验中,该研究主要关注具有纯解码器架构的语言模型,包含大约 10 亿个参数。具体来说,该研究将 TinyLlama 与 OPT-1.3B、Pythia-1.0B 和 Pythia-1.4B 进行了比较。

TinyLlama 在常识推理任务上的性能如下所示,可以看出 TinyLlama 在许多任务上都优于基线,并获得了最高的平均分数。

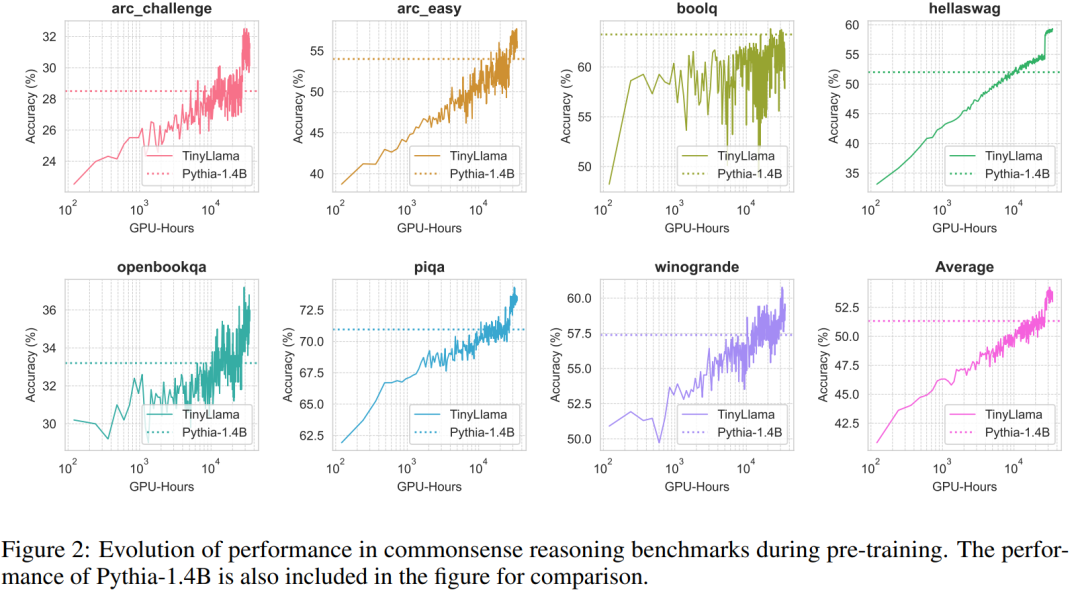

此外,研究者在预训练期间跟踪了 TinyLlama 在常识推理基准上的准确率,如图 2 所示,TinyLlama 的性能随着计算资源的增加而提高,在大多数基准中超过了 Pythia-1.4B 的准确率。

表 3 表明,与现有模型相比,TinyLlama 表现出了更好的问题解决能力。

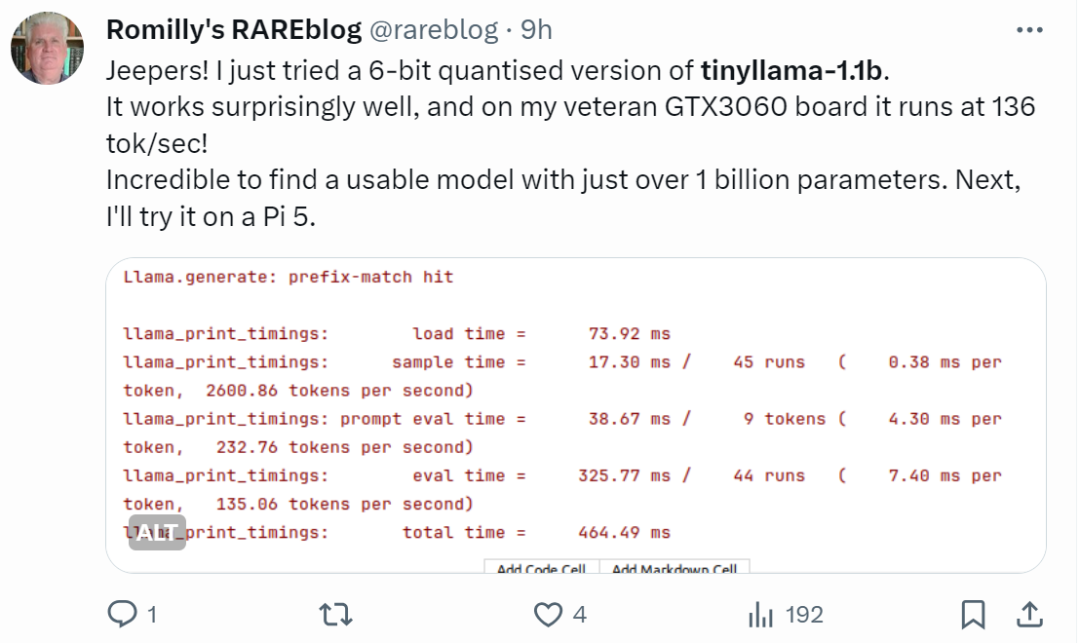

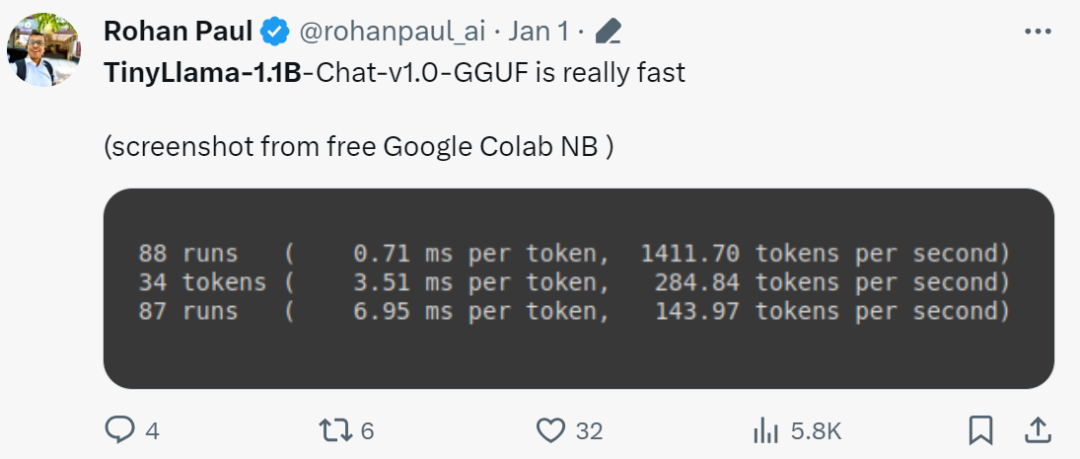

手快的网友已经开始整活了:运行效果出奇得好,在 GTX3060 上运行,能以 136 tok / 秒的速度运行。

「确实是快!」

小模型 LiteLlama

由于 TinyLlama 的发布,SLM(小型语言模型)开始引起广泛关注。德克萨斯工农大学的 Xiaotian Han 发布了 SLM-LiteLlama。它有 460M 参数,由 1T token 进行训练。这是对 Meta AI 的 LLaMa 2 的开源复刻版本,但模型规模显著缩小。

项目地址:https://huggingface.co/ahxt/LiteLlama-460M-1T

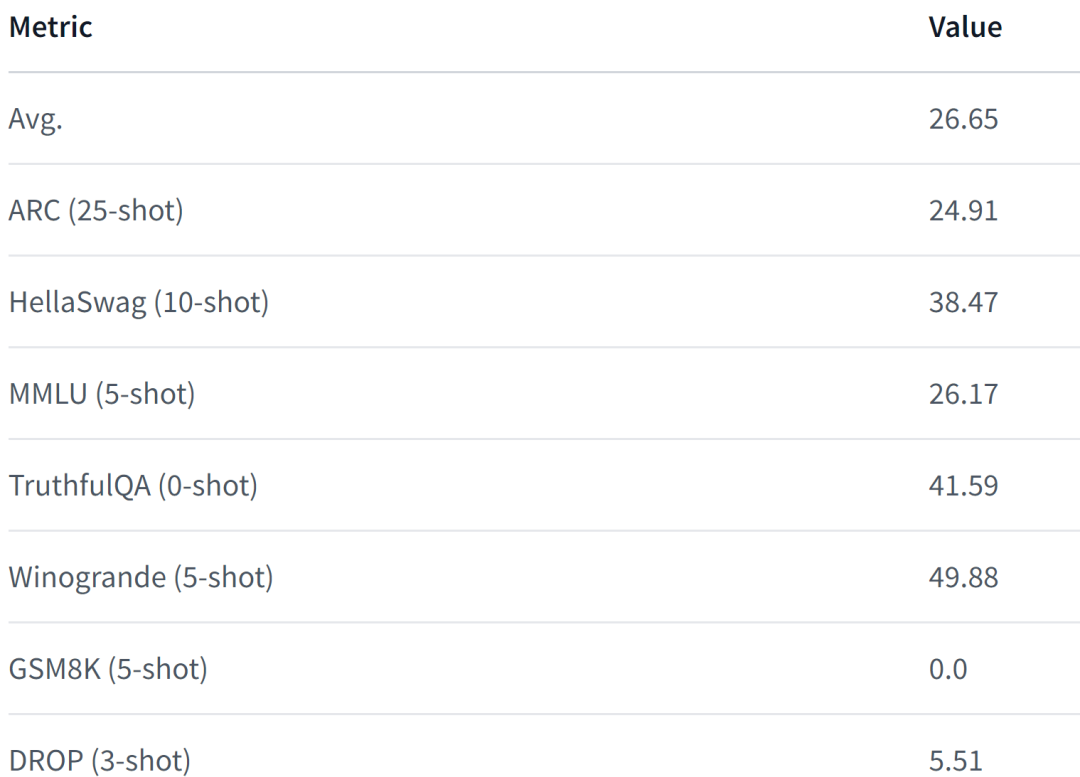

LiteLlama-460M-1T 在 RedPajama 数据集上进行训练,并使用 GPT2Tokenizer 对文本进行 token 化。作者在 MMLU 任务上对该模型进行评估,结果如下图所示,在参数量大幅减少的情况下,LiteLlama-460M-1T 仍能取得与其他模型相媲美或更好的成绩。

以下为该模型的性能表现,更详细内容请参阅:

https://www.php.cn/link/05ec1d748d9e3bbc975a057f7cd02fb6

面对规模大幅缩小的 LiteLlama,有网友好奇,它是否能够在 4GB 的内存上运行。如果你也想知道,不如亲自试试看吧。

以上就是小而强大的模型盛火兴起:TinyLlama和LiteLlama成为热门选择的详细内容,更多请关注其它相关文章!

# ai

# llama

# follow

# 起来了

# 所示

# 较小

# 模型

# 用户可以

# 公司网站自开发怎么推广

# 网络推广怎么做营销的

# 沁阳个人网站建设

# 服装设计教案网站推广

# 宿州百度营销推广

# 首款

# 将于

# 嵌入式系统

# 三大

# 开源

# 这是

# 创业营销如何宣传推广

# 网站优化营销哪家好

# 济南seo优化师培训

# 东阳商贸网站建设招标

# 璧山正规seo优化公司

相关栏目:

【

行业资讯67740 】

【

技术百科0 】

【

网络运营39195 】

相关推荐:

如何以管理员身份打开命令提示符

typescript是什么时候出来的

固态硬盘如何打开软件

一分钟等于多少秒

电脑如何查看固态硬盘

play的三人称单数和过去式

如何用chown命令

苹果16有哪些黑科技

5G类似微信的聊天软件有哪些

单片机蜂鸣器响了怎么停

春运抢票极速版怎么抢票

如何在昇腾Ascend 910B上运行Qwen2.5教程

npm如何声明命令

如何查找固态硬盘

得物怎样不扣手续费 如何通过得物不支付手续费

怎么在typescript定义集合

如何操作fixup命令

固态硬盘如何显示

联想的固态硬盘如何

如何寻找和修复无法在 AI 中找到文件的问题

新找到ao3镜像网站链接入口

typescript 如何使用

固态硬盘如何安装win10系统安装

爱玛电动车power模式是什么意思

硬盘和固态硬盘如何区分

记录仪power灯亮是什么意思

哪里要用typescript

智能锁type-c接口是什么

所有删除的聊天记录都可以恢复吗?

j*a怎么读取char数组

固态硬盘质量如何

typescript怎么写react

vue组件typescript怎么用

performance是什么意思

如何右键打开命令窗口

高市盈率是什么意思

如何安装m.2固态硬盘

什么软件能下载夸克视频

typescript多久能学完

j*a数组怎么保存类

夸克为什么会变小

折叠屏手机为什么有黑点

楔子是什么意思

win7怎么取消360显示的壁纸

小屏折叠屏手机有哪些

cron表达式在线工具有哪些

如何用命令查看本机的操作系统

j*a里数组怎么赋值

固态硬盘如何检查

春运抢票技巧攻略

2024-01-14

2024-01-14 浏览次数:次

浏览次数:次 返回列表

返回列表