新闻中心

自我奖励下的大型模型:Llama2通过Meta学习自行优化,超越GPT-4的性能

人工智能的反馈(aif)要代替 rlhf 了?

☞☞☞AI 智能聊天, 问答助手, AI 智能搜索, 免费无限量使用 DeepSeek R1 模型☜☜☜

论文标题:Self-Rewarding Language Models

论文链接:https://arxiv.org/a

bs/2401.10020

bs/2401.10020

刺鸟创客

刺鸟创客

一款专业高效稳定的AI内容创作平台

110

查看详情

110

查看详情

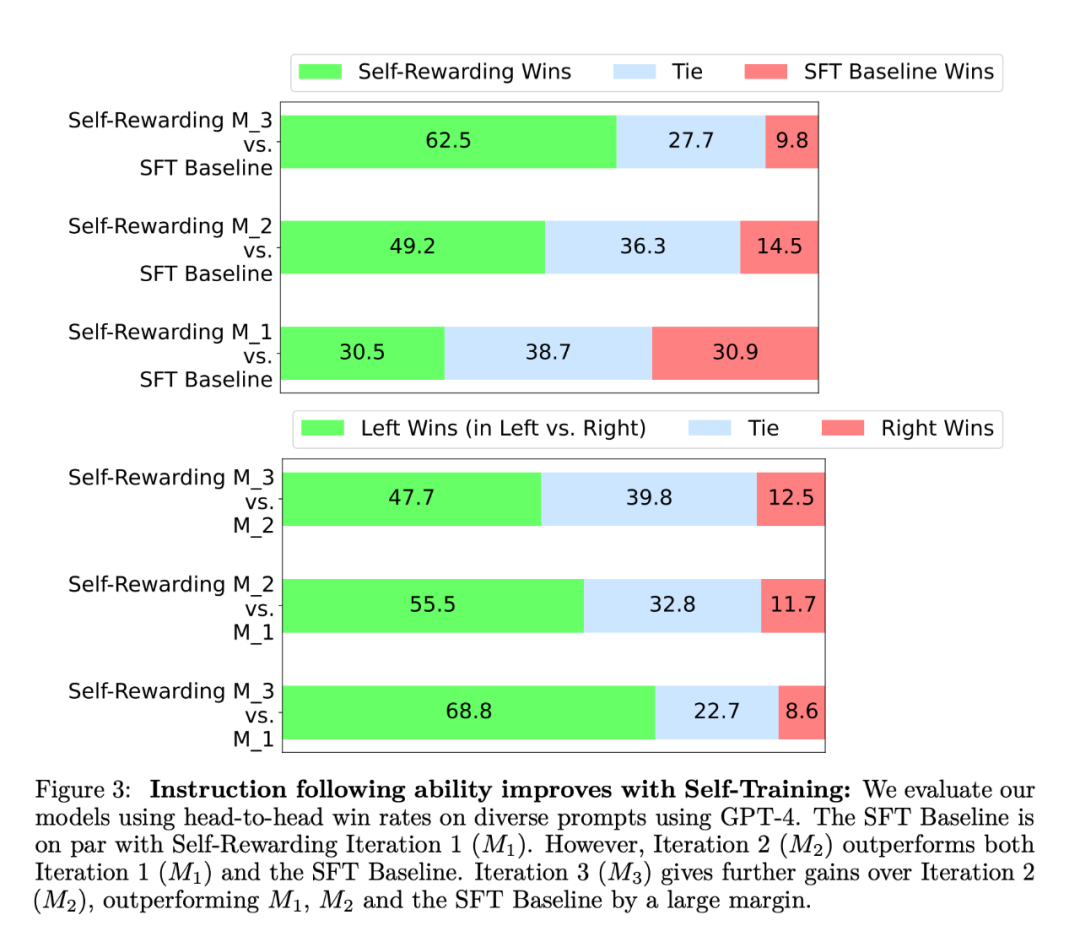

研究者在 AlpacaEval 2 排行榜上评估了自奖励模型,结果如表 1 所示。他们观察到了与 head-to-head 评估相同的结论,即训练迭代的胜率比 GPT4-Turbo 高,从迭代 1 的 9.94%,到迭代 2 的 15.38%,再到迭代 3 的 20.44%。同时,迭代 3 模型优于许多现有模型,包括 Claude 2、Gemini Pro 和 GPT4 0613。

研究者在 AlpacaEval 2 排行榜上评估了自奖励模型,结果如表 1 所示。他们观察到了与 head-to-head 评估相同的结论,即训练迭代的胜率比 GPT4-Turbo 高,从迭代 1 的 9.94%,到迭代 2 的 15.38%,再到迭代 3 的 20.44%。同时,迭代 3 模型优于许多现有模型,包括 Claude 2、Gemini Pro 和 GPT4 0613。

EFT在SFT基线上有所改进,使用IFT+EFT与单独使用IFT相比,五个测量指标都有所提高。例如,与人类的成对准确率一致性从65.1%上升到78.7%。

通过自我训练提高奖励建模能力。进行一轮自我奖励训练后,模型为下一次迭代提供自我奖励的能力得到了提高,此外它的指令跟随能力也得到了提高。

LLMas-a-Judge 提示的重要性。研究者使用了各种提示格式发现,LLMas-a-Judge 提示在使用 SFT 基线时成对准确率更高。

以上就是自我奖励下的大型模型:Llama2通过Meta学习自行优化,超越GPT-4的性能的详细内容,更多请关注其它相关文章!

# 纽约大学

# meta

# 给自己

# 自己的

# 迭代

# type

# llama

# claude

# gemini

# 自我奖励方法

# 工程

# 网站建设与开发公司合作

# 网站建设水平不高

# 签名素材网站建设

# 大亚湾网站推广哪里好

# 通用网站建设分类标准

# 推广平台无锡有哪些网站

# 济南请人做网站推广

# 绘画作品推广网站

# 滨州pc网站建设方案

# 重庆营销技术推广哪个好

# 提高了

# 两种

# 来了

# 所示

# 可以通过

# 开源

# 超越了

相关栏目:

【

行业资讯67740 】

【

技术百科0 】

【

网络运营39195 】

相关推荐:

春运抢票最新技巧与方法

苹果的type-c接口是什么

awk命令如何对两列加分隔符

如何用dos命令启动u盘

交管12123协议头不完整怎么解决

夸克网盘为什么解析错误

excel中datediff函数怎么用

记录仪power灯亮是什么意思

折叠屏手机哪个有性价比

element ui是什么

为什么要出折叠屏手机

摄像机的power chg是什么意思中文

如何进入安卓命令行

soup是什么意思

折叠屏手机好不好,耐不耐用

j*a数组怎么放字符

j*a怎么保存到数组

windows 如何连接ftp命令行

单片机程序负数怎么表示

苹果16送哪些配件

苹果16如何预购

春运抢票如何抢连坐的票

电动车充电器上的power是什么意思

春运抢票多久可以买到票

driver是什么意思

如何安装台式机固态硬盘

苹果16都有哪些型号

固态硬盘如何拆除

如何测固态硬盘芯片

npm如何声明命令

typescript有什么框架

j*a 数组怎么循环输出

考勤机power红灯是什么意思

如何寻找和修复无法在 AI 中找到文件的问题

市盈率回落是什么意思

vfp 命令窗口如何实现换行

苹果16有哪些变化尺寸

nfc功能是什么意思怎么开启

early什么意思

a03怎么根据编号找文链接入口

typescript为什么能运行

如何使用批处理命令编译vc程序

命令行下如何导出数据库

typescript如何定义变量

望远镜上power是什么意思

阿里云手机云盘怎么用_阿里云盘苹果手机怎么用教程

solidworks打开igs文件看不见要怎么办解决方法

红米手机怎么设置变成5G手机

win10如何开启命令行

hen是什么意思

2024-01-23

2024-01-23 浏览次数:次

浏览次数:次 返回列表

返回列表 bs/2401.10020

bs/2401.10020